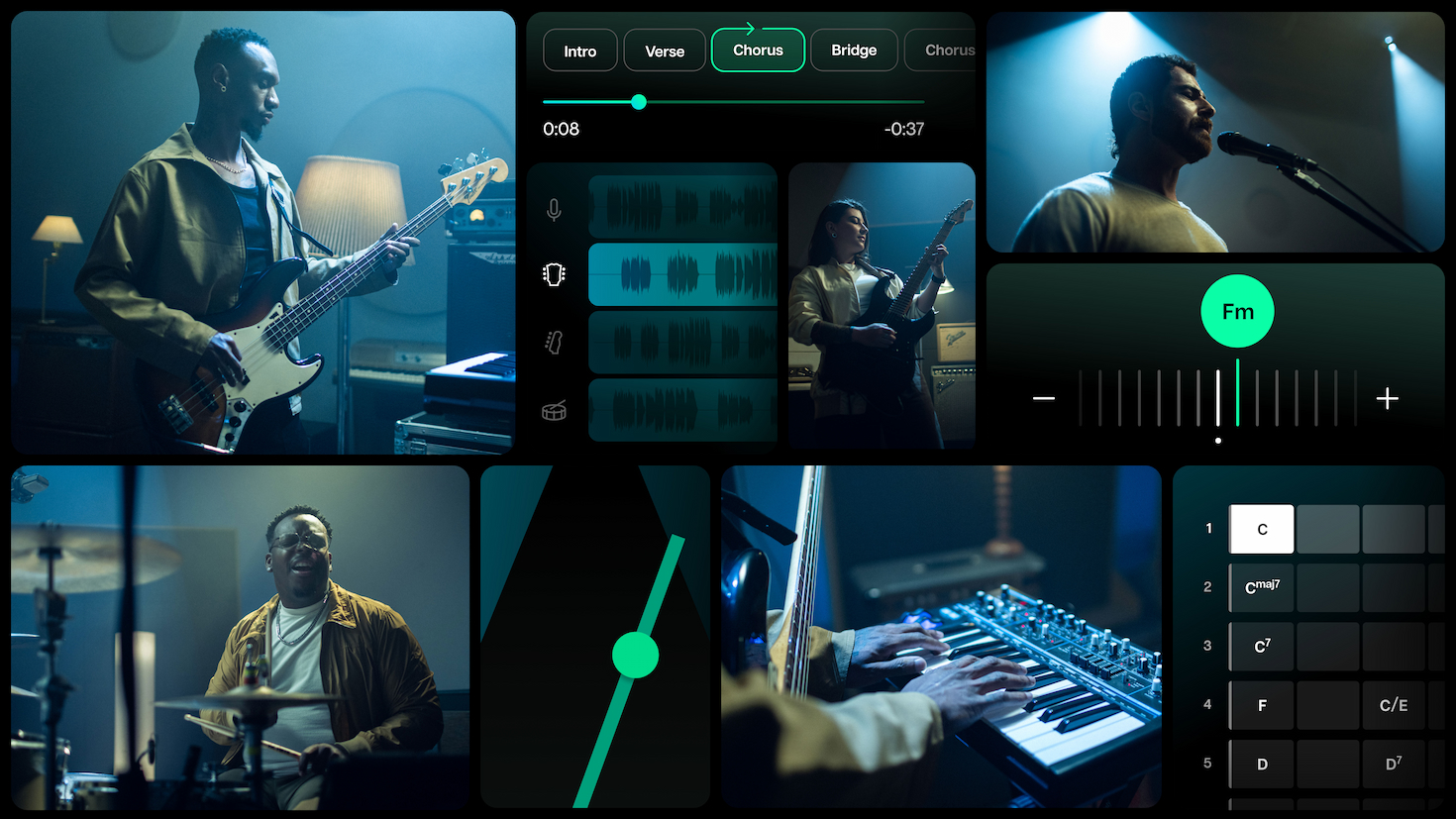

现在,你可以直接访问 Apple 智能核心的设备端基础模型,通过 Foundation Models 框架打造智能、私密且无需互联网连接的体验。借助对 Swift 的原生支持,只需三行代码即可利用该模型。借助这个框架,你可以通过文本提取、摘要等模型功能,为 App 中的智能功能提供支持。框架中内置了引导式生成、工具调用等功能,让你能够更轻松地在现有 App 和游戏中实现智能体验。

机器学习与 AI

利用强大的设备端机器学习功能,为你的 App 和游戏打造智能功能,带来全新的体验。了解如何在 iPhone、iPad、Apple Vision Pro、Mac 和 Apple Watch 中构建、使用、训练和部署机器学习及 AI 模型。