-

Découvrir les frameworks d’apprentissage automatique et d’IA sur les plates-formes Apple

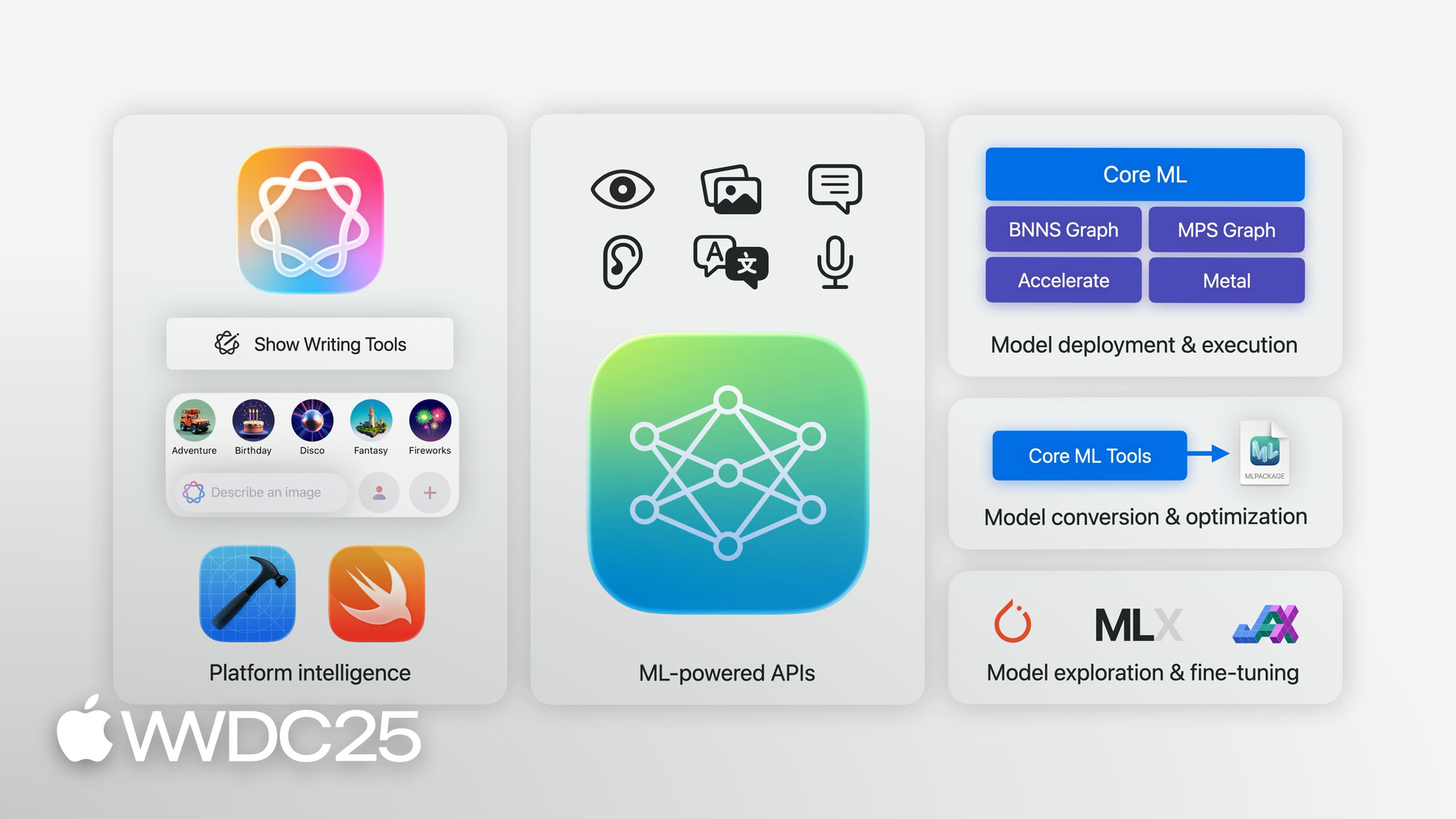

Découvrez les dernières mises à jour des frameworks d'apprentissage automatique et d'IA disponibles sur les plates-formes Apple. Que vous soyez un développeur d'apps prêt à exploiter Apple Intelligence, un ingénieur en apprentissage automatique optimisant des modèles pour un déploiement sur appareil, ou un passionné d'IA explorant les limites possibles, nous vous guiderons pour choisir les outils les mieux adaptés à vos besoins.

Chapitres

- 0:00 - Introduction

- 1:18 - Intelligence des plates-formes

- 8:20 - API alimentées par le ML

- 11:15 - Modèles d’apprentissage automatique

- 14:54 - Exploration

Ressources

-

Rechercher dans cette vidéo…

-

-

- 0:00 - Introduction

L’équipe On-Device Machine Learning d’Apple propose des outils aux développeurs et aux passionnés pour intégrer Apple Intelligence et l’apprentissage automatique dans leurs apps et leurs projets personnels. Apprenez-en davantage sur l’intelligence des plateformes, les system frameworks, l’optimisation et le déploiement des modèles, et restez informé des dernières innovations en matière d’apprentissage automatique et d’IA sur les équipements Apple.

- 1:18 - Intelligence des plates-formes

L’apprentissage automatique et l’intelligence artificielle sont au cœur de notre système d’exploitation et optimisent diverses apps et fonctionnalités intégrées. Ces technologies offrent une expérience utilisateur fluide, notamment grâce à une authentification sécurisée, la reconnaissance de l’écriture manuscrite et la réduction du bruit pendant les appels. L’année dernière, l’intelligence générative a été intégrée au cœur de notre système d’exploitation avec les outils d’écriture, Genmoji et Image Playground. Ces fonctionnalités sont conçues pour être aisément intégrées aux apps existantes, ce qui vous permet d’améliorer vos UI avec un minimum d’effort. Une vaste gamme d’API basées sur l’apprentissage automatique est disponible. Ces API offrent un accès programmatique aux modèles et fonctionnalités du système, permettant ainsi d’effectuer des tâches telles que la génération d’images avec ImageCreator et de proposer des suggestions de réponses intelligentes. L’introduction du framework de Foundation Models dans iOS 26 simplifie encore davantage ce processus. Ce framework permet d’accéder à un modèle de langage hautement optimisé sur appareil, spécialisé dans les tâches quotidiennes. Il peut être utilisé pour la synthèse, l’extraction, la classification des contenus et bien plus encore, tout en garantissant la confidentialité des données des utilisateurs, car le modèle fonctionne entièrement hors ligne. Vous pouvez aisément interagir avec le modèle, générer des réponses structurées et même l’intégrer à des données en direct ou personnelles à l’aide d’outils d’appel, ce qui permet au modèle d’effectuer des actions et de citer des sources fiables.

- 8:20 - API alimentées par le ML

Les API optimisées par l’apprentissage automatique vous offrent une suite complète d’outils qui rendent vos apps plus intelligentes. Ces frameworks comprennent Vision pour l’analyse d’images et de vidéos, Langage naturel pour le traitement de texte, Traduction pour les langues, Analyse sonore pour la reconnaissance des sons et Parole pour la reconnaissance et la transcription. Parmi les nouveautés les plus remarquables, citons la reconnaissance de documents et la détection des traces sur l’objectif dans Vision, ainsi que l’API SpeechAnalyzer dans Parole, qui permet un traitement plus rapide et plus flexible de la reconnaissance automatique de la parole, en particulier pour les enregistrements audio longs ou avec un son lointain. Les développeurs peuvent également personnaliser ces modèles à l’aide de l’app et du framework CreateML.

- 11:15 - Modèles d’apprentissage automatique

Core ML simplifie le processus d’intégration des modèles d’apprentissage automatique dans les apps pour les appareils Apple. Vous pouvez utiliser des modèles déjà au format CoreML, disponibles sur developer.apple.com et dans l’espace Apple sur Hugging Face, ou convertir des modèles entraînés à partir d’autres formats à l’aide des outils CoreML. CoreML Tools optimise ces modèles pour une exécution sur l’appareil, en réduisant leur taille et en améliorant leurs performances grâce à des techniques automatiques et manuelles. Vous pouvez ensuite intégrer facilement ces modèles dans Xcode, où vous pouvez inspecter les performances, visualiser l’architecture du modèle et générer des interfaces Swift sécurisées. Lors de l’exécution, CoreML exploite le processeur, le GPU et le Neural Engine pour assurer une exécution efficace. Pour un contrôle plus avancé, combinez les modèles CoreML avec MPSGraph, Metal ou l’API BNNS Graph d’Accelerate, qui dispose de nouvelles fonctionnalités cette année, notamment un BNNSGraphBuilder pour les tâches d’apprentissage automatique en temps réel basées sur le processeur.

- 14:54 - Exploration

Compte tenu du rythme effréné de la recherche dans le domaine de l’apprentissage automatique, il est essentiel de s’équiper d’outils et de ressources sophistiqués pour rester à la pointe. MLX d’Apple, un framework open source pour le calcul numérique et l’apprentissage automatique, est conçu pour exploiter toute la puissance de la puce Apple. MLX permet un réglage, un entraînement et un apprentissage distribué efficaces des modèles de pointe sur les appareils Apple. Il est capable d’exécuter de grands modèles de langage à l’aide d’un seul appel de ligne de commande et tire parti de l’architecture de mémoire unifiée de la puce Apple, permettant des opérations parallèles du processeur et du GPU sur la même mémoire tampon. Vous pouvez accéder à MLX en Python, Swift, C++ et d’autres langages. De plus, Apple prend en charge les frameworks d’entraînement populaires, tels que PyTorch et Jax via Metal. Le site web developer.apple.com et les référentiels Github d’Apple constituent des ressources précieuses pour les passionnés et les chercheurs en IA, car ils donnent accès aux dernières ressources d’Apple en matière d’apprentissage automatique.