-

Descubre las estructuras de aprendizaje automático e IA en las plataformas de Apple

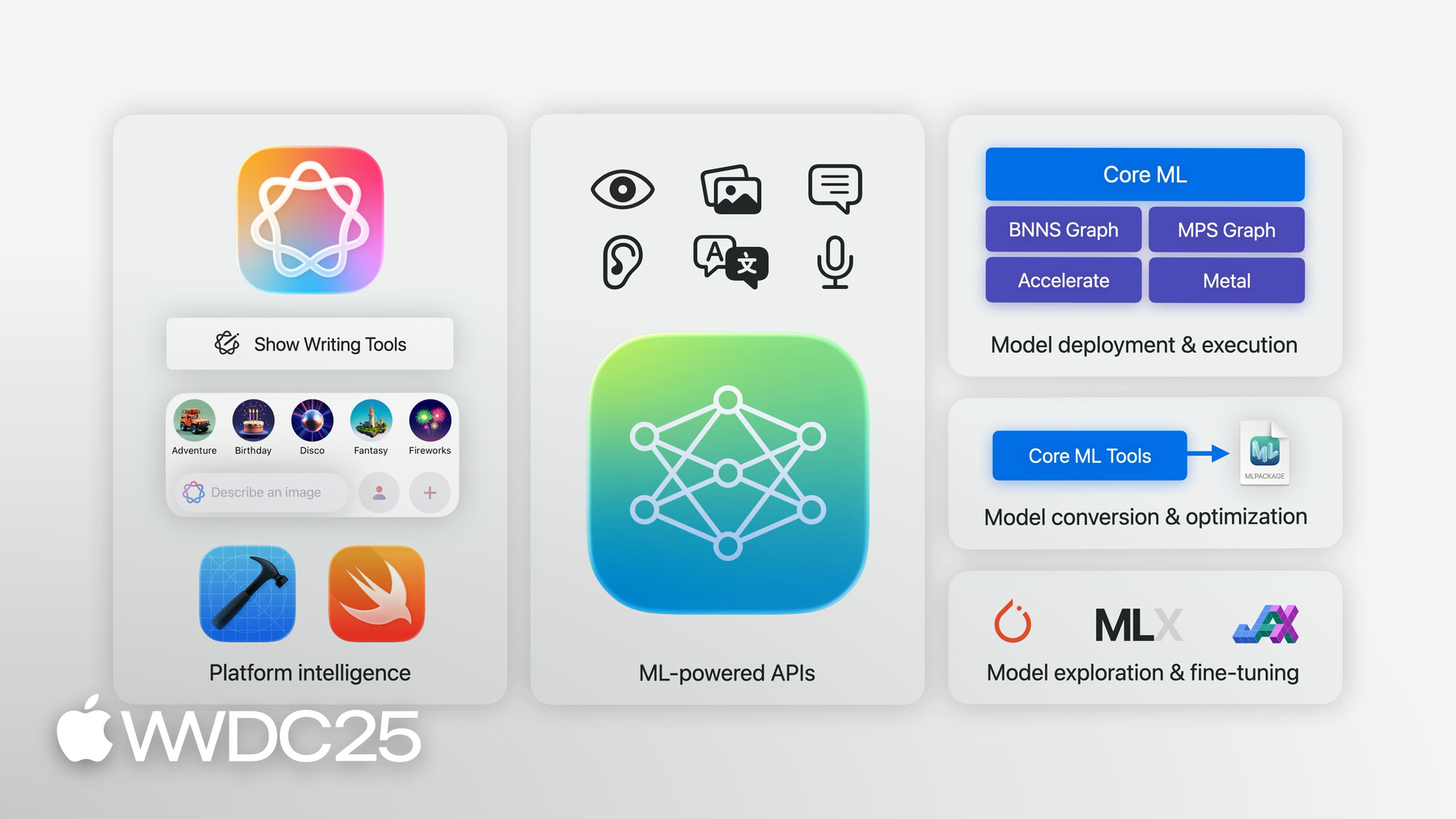

Te daremos un recorrido por las actualizaciones de aprendizaje automático y estructuras de IA. Tanto si eres un desarrollador que quiere aprovechar Apple Intelligence, como si eres un ingeniero de aprendizaje automático que optimiza modelos para su implementación, o un entusiasta de la IA que explora las posibilidades, ofrecemos asesoría sobre las herramientas adecuadas.

Capítulos

- 0:00 - Introducción

- 1:18 - Inteligencia de plataforma

- 8:20 - API impulsadas por aprendizaje automático

- 11:15 - Modelos de aprendizaje automático

- 14:54 - Exploración

Recursos

-

Buscar este video…

-

-

- 0:00 - Introducción

El equipo de On-Device Machine Learning de Apple ofrece herramientas para que los desarrolladores y entusiastas integren Apple Intelligence y el aprendizaje automático en apps y proyectos personales. Obtén más información sobre inteligencia de plataforma, estructuras de sistemas, optimización e implementación de modelos, y cómo estar actualizado sobre las innovaciones más recientes de ML e IA en hardware de Apple.

- 1:18 - Inteligencia de plataforma

El aprendizaje automático y la inteligencia artificial son la base de nuestro SO, y potencian varias apps y funcionalidades integradas. Estas tecnologías permiten experiencias de usuario fluidas, como la autenticación segura, reconocimiento de escritura a mano y reducción de ruido durante las llamadas. El año pasado incorporamos la inteligencia generativa al núcleo de nuestro sistema operativo con Herramientas de Escritura, Genmoji e Image Playground. Estas funcionalidades están diseñadas para integrarse fácilmente en apps existentes, para que puedas mejorar tus interfaces de usuario con el mínimo esfuerzo. Se encuentra disponible una amplia gama de API impulsadas por ML. Estas API ofrecen acceso programático a los modelos y capacidades del sistema, y así se habilitan tareas como la generación de imágenes con ImageCreator y sugerencias de respuestas inteligentes. La incorporación de la estructura Foundation Models en iOS 26 simplifica aún más este proceso. Proporciona acceso programático a un modelo de lenguaje en el dispositivo altamente optimizado y especializado para las tareas cotidianas. Puedes usarlo para resumir, extraer, clasificar, entre otras tareas, y al mismo tiempo garantizas la privacidad de los datos del usuario, ya que el modelo funciona completamente sin conexión. Puedes solicitar fácilmente el modelo, generar respuestas estructuradas e incluso integrarlo con datos en tiempo real o personales con llamadas a herramientas, lo que permite que el modelo realice acciones y cite fuentes de confianza.

- 8:20 - API impulsadas por aprendizaje automático

Las API actualizadas impulsadas por aprendizaje automático te ofrecen un conjunto integral de herramientas para mejorar la inteligencia de las app. Las estructuras incluyen Vision para el análisis de imágenes y videos, Natural Language para el procesamiento de texto, Translation para idiomas, Sound Analysis para reconocer sonidos y Speech para reconocimiento y transcripción. Algunas de las novedades destacadas son el reconocimiento de documentos y la detección de manchas en el lente en Vision, y la API SpeechAnalyzer en Speech, que permite un procesamiento de voz a texto más rápido y flexible, en particular para audio de formato largo y distante. Los desarrolladores también pueden personalizar estos modelos con la app y estructura CreateML.

- 11:15 - Modelos de aprendizaje automático

Core ML simplifica el proceso de integración de modelos de aprendizaje automático en apps para dispositivos Apple. Puedes usar modelos en formato CoreML, disponibles en developer.apple.com y en el espacio de Apple en Hugging Face, o convertir modelos entrenados desde otros formatos con las herramientas CoreML. CoreML Tools optimiza estos modelos para la ejecución en el dispositivo, reduce el tamaño y mejora el rendimiento con técnicas automáticas y manuales. Luego, puedes integrar fácilmente estos modelos en Xcode, donde puedes consultar el rendimiento, visualizar la arquitectura del modelo y generar interfaces Swift seguras para tipos. En tiempo de ejecución, CoreML aprovecha el CPU, el GPU y el Neural Engine para una ejecución eficiente. Para un control más avanzado, combina los modelos CoreML con MPSGraph, Metal Compute o la API BNNS Graph de Accelerate, con nuevas capacidades este año, entre ellas, un BNNSGraphBuilder para tareas de ML basadas en CPU en tiempo real.

- 14:54 - Exploración

El ritmo rápido de la investigación en aprendizaje automático exige herramientas y recursos sofisticados para estar actualizados. Apple MLX, una estructura de conjunto de código abierto para computación numérica y aprendizaje automático, está diseñado para aprovechar el poder de Apple Silicon. MLX permite el ajuste eficiente, el entrenamiento y el aprendizaje distribuido de modelos de última generación en dispositivos Apple. Ejecuta modelos de lenguaje grandes con una sola llamada de línea de comando y aprovecha la arquitectura de memoria unificada de Apple Silicon, lo que permite operaciones paralelas de CPU y GPU en el mismo búfer. Puedes acceder a MLX en Python, Swift, C++ y otros lenguajes. Además, Apple admite estructuras de aprendizaje populares, como PyTorch y Jax, a través de Metal. Los entusiastas e investigadores de IA cuentan con recursos valiosos, como el sitio web developer.apple.com y los repositorios Github de Apple, que brindan acceso a las fuentes de información más recientes de aprendizaje automático de Apple.